ChatGPT в последнее время стал настоящей звездой соцсетей и новостных заголовков - этот чат-бот на основе ИИ способен поддерживать беседу и вести сложную аргументацию - совсем как живой человек. Более того, он способен писать тексты приличного качества, и даже генерировать код и верстать веб-страницы.

Название GPT можно расшифровать как “предварительно обученный генеративный преобразователь” (Chat Generative Pre-trained Transformer). Третье поколение этой языковой модели было представлено разработчиками OpenAI перед широкой общественностью 30 ноября 2022 года. Она предназначена для предоставления ответов, подобных человеческим, на различные входные данные с применением алгоритмов.

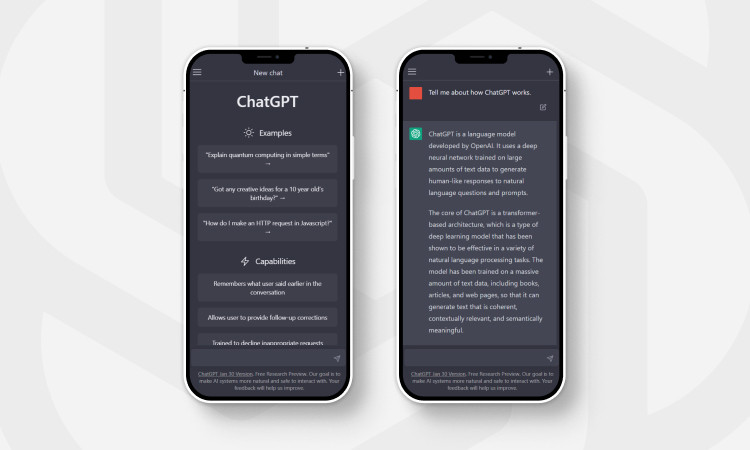

Исследователи ИИ знают о существовании высокоэффективного языкового искусственного интеллекта. Но в случае с ChatGPT это впервые, когда такой мощный инструмент стал доступен широкой публике через бесплатный и удобный онлайн-интерфейс.

Как выразился Варун Майя, CEO софтверной компании Avalon Labs, ChatGPT очень похож на человека: “Он точно такой же, как человек, за исключением того, что он абсолютно компетентен”.

Совсем недавно ChatGPT покорил соцсети вирусными видеороликами, где он пишет стихи в стиле Шекспира, размышляет о философских проблемах и находит дефекты в компьютерном коде.

Эти примеры достойны внимания, ведь они такого высокого уровня, что похожи на произведения человека. И при этом ChatGPT — это даже не лучший ИИ; OpenAI, по-видимому, разрабатывает более совершенную модель, которая стала доступной уже в 2023 году.

Это похоже на раннюю эру Интернета, еще в 1990-е годы, когда все такие: “Это прорыв?” Это не прорыв…”, — продолжает Майя, CEO Avalon Labs, который занимается созданием программного обеспечения уже десять лет. “Но теперь ясно, вне всякого сомнения, это прорыв. Это очень инновационно”.

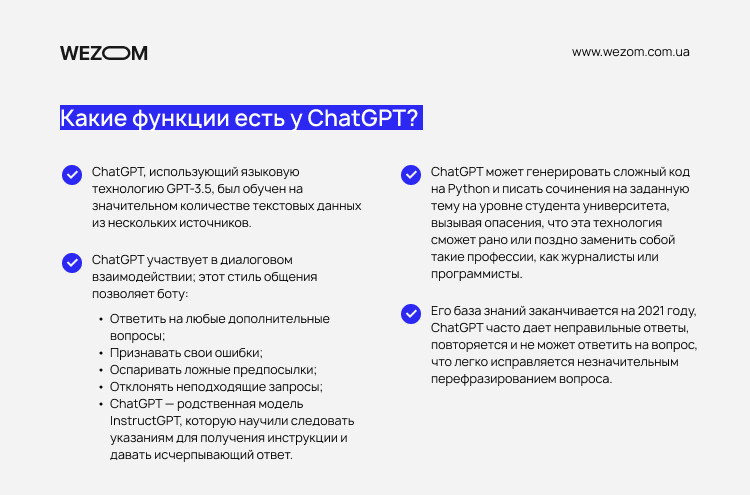

Какие функции есть у ChatGPT?

Поскольку программное обеспечение все еще находится на этапе “инкубации”, в настоящее время существует два типа пользователей: те, кто использует его функционально (например, дизайнер продукта, использовавший бота для создания полнофункционального приложения), и те, кто использует его для досуга (например, для создания бота, общающегося в стиле Шекспира).

Вот некоторые из его особенностей:

1. ChatGPT,использующий языковую технологию GPT-3.5, был обучен на значительном количестве текстовых данных из нескольких источников.

2. ChatGPT участвует в диалоговом взаимодействии,этот стиль общения позволяет боту:

-

Ответить на любые дополнительные вопросы;

-

Признавать свои ошибки;

-

Оспаривать ложные предпосылки;

-

Отклонять неподходящие запросы;

-

ChatGPT — родственная модель InstructGPT, которую научили следовать указаниям для получения инструкции и давать исчерпывающий ответ.

3. Но самое важное - ChatGPT может генерировать сложный код на Python и писать сочинения на заданную тему на уровне студента университета, вызывая опасения, что эта технология сможет рано или поздно заменить собой такие профессии, как журналисты или программисты.

4. Его база знаний заканчивается на 2021 году, ChatGPT часто дает неправильные ответы, повторяется и не может ответить на вопрос, что легко исправляется незначительным перефразированием вопроса.

Принцип работы ChatGTP

Как и в случае с InstructGPT, для обучения этой модели использовалось обучение с подкреплением на основе обратной связи с человеком (RLHF) с несколькими незначительными вариациями в схеме сбора данных. Для обучения исходной модели использовалась контролируемая настройка, позволяющая инструкторам искусственного интеллекта быть одновременно как пользователями, так и помощниками ИИ во время общения. Инструкторы имели доступ к примерам письменных рекомендаций, чтобы помочь модели при составлении ответов.

Также потребовались сравнительные данные, включавшие как минимум два модельных ответа, упорядоченных по качеству, чтобы построить модель вознаграждения для обучения с подкреплением. Использовались взаимодействия с чат-ботом, проводимые тренерами с ИИ для получения этих данных. Утверждение, написанное по образцу, выбиралось случайным образом, в нем выбирался ряд потенциальных выводов, и инструкторов ИИ просили оценить их. Проксимальная политика оптимизации может использоваться для настройки модели с использованием этих моделей вознаграждения. Цикл этого метода повторяли много раз.

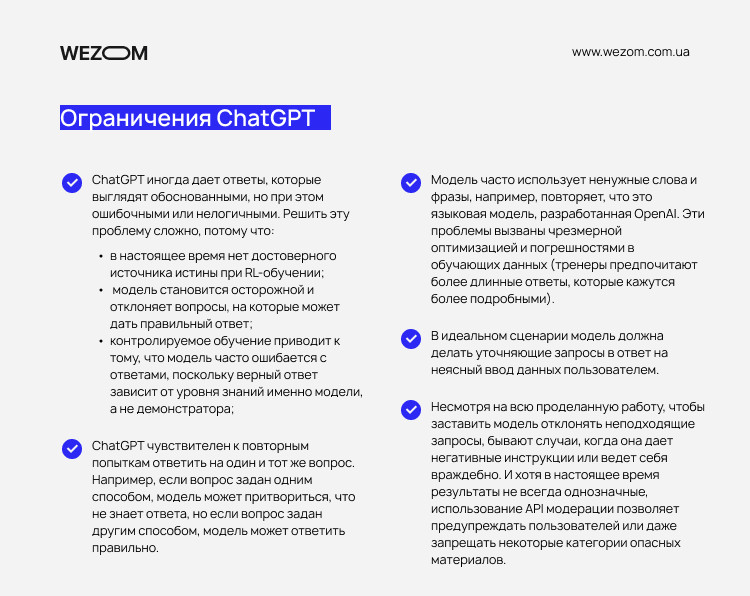

Ограничения ChatGPT

С одной стороны, ChatGPT действительно способен давать ответы, выглядящие очень убедительно. Но, с другой стороны, эта убедительность зависит от контекста.

Что входит в ограничения:

1. ChatGPT иногда дает ответы, которые выглядят обоснованными, но при этом ошибочными или нелогичными. Решить эту проблему сложно, потому что:

-

в настоящее время нет достоверного источника истины при RL-обучении;

-

модель становится осторожной и отклоняет вопросы, на которые может дать правильный ответ;

-

контролируемое обучение приводит к тому, что модель часто ошибается с ответами, поскольку верный ответ зависит от уровня знаний именно модели, а не демонстратора;ChatGPT чувствителен к повторным попыткам ответить на один и тот же вопрос. Например, если вопрос задан одним способом, модель может притвориться, что не знает ответа, но если вопрос задан другим способом, модель может ответить правильно.

2. ChatGPT чувствителен к повторным попыткам ответить на один и тот же вопрос. Например, если вопрос задан одним способом, модель может притвориться, что не знает ответа, но если вопрос задан другим способом, модель может ответить правильно.

3. Модель часто использует ненужные слова и фразы, например, повторяет, что это языковая модель, разработанная OpenAI. Эти проблемы вызваны чрезмерной оптимизацией и погрешностями в обучающих данных (тренеры предпочитают более длинные ответы, которые кажутся более подробными).

4. В идеальном сценарии модель должна делать уточняющие запросы в ответ на неясный ввод данных пользователем.

5. Несмотря на всю проделанную работу, чтобы заставить модель отклонять неподходящие запросы, бывают случаи, когда она дает негативные инструкции или ведет себя враждебно. И хотя в настоящее время результаты не всегда однозначные, использование API модерации позволяет предупреждать пользователей или даже запрещать некоторые категории опасных материалов.

Как это возникло

В 2015 году Альтман, Маск и другие инвесторы Кремниевой долины создали OpenAI как некоммерческую организацию, занимающуюся исследованиями в области искусственного интеллекта. В 2015 году OpenAI изменил свой юридический статус, став бизнесом с “ограниченной прибылью” - это означает, что он снижает доходность инвестиций после определенного порога.

В 2018 году Маск ушел из совета директоров из-за конфликта интересов, связанного с OpenAI и исследованиями автономного вождения, проводимыми Tesla. Тем не менее он продолжает инвестировать и выразил энтузиазм по поводу дебюта ChatGPT. Он прокомментировал это так: «ChatGPT пугающе превосходен». ChatGPT - это уже не первый чат-бот с искусственным интеллектом. Многие компании, в том числе Microsoft, экспериментировали с чат-ботами, но им сильно не везло. Когда в 2016 году бот Microsoft Tay был впервые представлен широкой общественности, пользователи Twitter якобы менее чем за сутки научили его сексистским и расистским выражениям, что в конечном итоге привело к его ликвидации.

Запуск в августе BlenderBot 3 стало первым шагом Meta в индустрии чат-ботов. По данным Mashable, этот бот, как и Тай, подвергся критике за распространение расовой, антисемитской и неправдивой информации. В частности, он сделал заявление, что Дональд Трамп победил на президентских выборах 2020 года.

OpenAI применила Moderation API - систему модерации на основе ИИ, чтобы помочь разработчикам определить, нарушает ли язык политику компании в отношении контента, направленную на бан вредоносных или незаконных материалов. Это должно предотвратить сомнительные эпизоды такого рода. Но в OpenAI признают, что их модерация все еще сталкивается с проблемами и далека от идеала.

В заключение

Означает ли все это, что ИИ будет управлять человечеством? Пока нет, но Альтман из OpenAI убежден, что ИИ не так уж и далек от “человеческого” способа мышления. Однако для достижения уровня оптимальной производительности модели AI и ML потребуют большого количества “тренировок” и тонкой настройки, которых можно достигнуть только человеческими усилиями.

Наша статья откроет для вас передовые технологические инновации 2024 года!

Разработчик также отметил, что программное обеспечение не всегда точно срабатывает и может давать ответы, которые либо неверны, либо нелогичны, но кажутся разумными или основанными на фактах, что может поддерживать распространение ложной информации.

Напоследок нужно подчеркнуть, что ChatGPT не может полностью понять нюансы устной и письменной речи человека. Его просто учат произносить слова в зависимости от ввода, однако ему не хватает способности полностью понимать значение этих слов. Это означает, что по сравнению с ответами настоящего человека любые ответы, которые он производит, вероятно, будут поверхностными и лишенными глубины и понимания.