Проблема дублирования контента нечасто упоминают в рецензиях на сайты или дискуссиях на SEO-форумах. Тем не менее она может нанести немалый вред вашему сайту.

Каннибализация ключевых слов происходит тогда, когда несколько страниц одного сайта содержат одни и те же либо похожие ключевые слова, тем самым мешая поисковой системе выбрать, какая из страниц больше всего подходит для отображения в результатах поиска по данному слову.

Это явление не только вызывает раздражение у владельцев сайтов, но и плохо влияет на рейтинг ресурса, помещая тот или иной сайт среди ошибочных или нежелательных результатов поиска по определенному запросу.

Что такое дубли страниц и их виды

Дубли — это веб-страницы, которые имеют одинаковое содержимое, но при этом разные URL-адресы. Другими словами, они представляют собой отдельные страницы сайта, контент которых полностью или частично совпадает. Исходя из этого, выделяют два основных вида дублей — полные и частичные.

Что такое дубли — разобрались. Теперь перейдем к тому, почему это плохо.

В зависимости от того, насколько содержимое одинаковое, дубли страниц на сайте принято классифицировать на:

- полные;

- частичные.

Остановимся на каждом детальнее.

Полные дубли

Они содержат на 100 % идентичный контент. Но при этом материалы размещены на разных урлах.

Среди основных примеров:

- зеркала веб-ресурса, адреса которых содержат «www» или нет. В таком случае важно определить основное зеркало;

- дубли главной. В основном они связаны со спецификой системы CMS по управлению ресурсом;

- дублированный контент реферальных ссылок. Они могут попадать под индексацию поисковыми ботами, в итоге создаются ненужные страницы, которые мешают продвижению нужных;

- дубли, обусловленные ошибкой в иерархии. Если логика каталога составлена неверно, то идентичные карточки товаров будут размещаться под разными урлами;

- неверная настройка 404 страницы. Если сервер отдает ответ 200, то получается бесконечное количество дублей;

- веб-страницы с метками utm. Они содержат в себе важные параметры, которые помогают в отслеживании рекламных кампаний. Однако у них идентичное страницам сайта наполнение;

- веб-страницы, которые в URL содержат большое количество слэш(//, ///);

- дубли, появление которых обусловлено неправильно выполненным переездом на протокол SSL.

Все перечисленные случаи требуют оперативного устранения и внимания SEO-специалиста.

Частичные дубли

Так называются страницы, на которых содержится только часть идентичного для нескольких урлов контента. В основном они генерируются системами CMS.

Среди основных примеров:

- веб-страницы пагинации, сортировки. Они обычно имеют отношение к CMS, о чем свидетельствует специальный параметр get;

- веб-страницы с результатами поиска. Основная их опасность заключается в том, что посетители могут невольно генерировать их в большом количестве за короткое время;

- дубли на карточках товаров. Также они встречаются на страничках с отзывами, характеристиками, комментариями. Они генерируются на сайтах магазинов в процессе выбора табов на карточке товаров;

- страницы для скачивания и печати;

- HTML-дубли веб-страниц, которые созданы при помощи AJAX.

Такие случаи тоже требуют оперативного исправления, поскольку, независимо от типа, дублирование контента негативным образом сказывается на продвижении ресурса. Расскажем детальнее.

Как дублирование контента влияет на SEO?

Во время просмотра страниц вашего сайта поисковая система видит, что некоторые из них кажутся одинаково релевантными определенному ключевому слову.

Допустим, ключевое слово в запросе – «игрушки для собак». То, что оно встречается на одной или нескольких страницах вашего сайта, вовсе не значит, что Google посчитает ресурс более релевантным запросу об игрушках для собак, чем сайты ваших конкурентов. Скорее, Google придется выбирать среди нескольких страниц вашего сайта, решая, какая из них наиболее соответствует запросу. В этом случае множество инструментов, которые используются этим ресурсом, утрачивают свою значимость:

Анкорный текст. Из-за того, что вы ссылаетесь сразу на несколько страниц, объединенных одной темой, вес не концентрируется по ссылке с анкором, а значит, и не передается нужной нам странице.

Внешние ссылки. Если 4 внешних ссылки указывают на одну страницу вашего сайта с ключевым словом «игрушки для собак», 2 сайта-донора ссылаются на другую его страницу с этим же ключом, а еще на 7 ресурсах размещена ссылка на третью страницу вашего сайта, содержащую схожий контент, то вы распыляете вес внешних ссылок по страницам вместо того, чтобы сконцентрировать его на одной из них.

Качество контента. Если автор пишет четыре статьи подряд на одну и ту же тему, качество контента будет не на высоте, не так ли? Пусть лучше будет одна страница, привлекающая наибольшее число внешних ссылок и рефералов, чем несколько ничем не примечательных страниц-клонов.

Коэффициент конверсии. Если конверсия определенной страницы вашего сайта выше, чем конверсия других его страниц, задумайтесь, зачем вам страницы, нацеленные на ту же аудиторию, однако имеющие меньшее количество переходов. Начните отслеживать переходы на сайт, чтобы узнать конверсию.

Как найти дубли страниц?

Существует несколько способов поиска дублей страниц. Каждый из них имеет свои преимущества и недостатки.

Чаще всего поиск осуществляется с помощью:

- поисковых операторов;

- специализированных программ;

- сервисов web-аналитики;

- панели Search Console Google.

Также можно искать страницы вручную. Подробная инструкция, как найти дубли страниц разными способами, — далее.

С помощью инструментов

Есть разные специальные программы, которые выполняют поиск дублей страниц сайта. Они сканируют ресурс, после чего формируют отчет с найденными результатами. К таким инструментам относятся:

- Netpeak Spider;

- Xenu;

- Screaming Frog Seo Spider.

Эти программы находят страницы на ресурсе с полностью идентичным контентом, с дублями в блоке, повторы «title», «description». Поиск потенциальных дублей может выполнить также сервис Serpstat, которым пользуются многие SEO-специалисты.

С помощью поисковых операторов

Найти дубли страниц на сайте можно и другим способом – проанализировав те из них, которые уже прошли индексацию. Используется для этого «site:» – специальный оператор, который вводится в строку поисковика вместе с другой комбинацией специальных символов. Выглядит запрос следующим образом: «site:examplesite.net».

После введения команды и запуска функции поиска в выдаче отобразятся веб-страницы в общем индексе. Таким образом можно отследить, насколько количество отличается от тех, которые содержатся в карте XML или найдены спайдером. Проанализировав выдачу, получится обнаружить «мусорные» страницы и те, на которых есть дублирование контента. Их нужно удалять из индекса.

Еще поиск можно выполнить через анализ выдачи по отдельным фрагментам текста. Брать за образец нужно контент с тех веб-страниц, которые по подозрению могут иметь дубли. Выполняется поиск следующим образом: отрезок текста берется в кавычки, ставится пробел, вписывается «site:». Например:

«Часть текста, которая возможно продублирована» site:examplesite.net.

Все это нужно ввести в поисковую строку. Еще требуется указать ссылку на свой ресурс, чтобы обнаружить страницы с идентичным текстом. Если в результате отображается лишь одна страница, то дублей нет, а вот когда несколько, то нужно их проанализировать, разобраться с причинами дублирования контента.

Таким же образом можно использовать и оператор «intitle». Он помогает анализировать содержание title на страницах, которые отображаются в выдаче. Копирование этой части текста часто указывает на наличие дублей страниц. Наверняка убедиться можно проверив. Для этого необходимо тоже использовать «site:». Пример запроса будет таким:

site:examplesite.net intitle: текст title полностью или частично.

Также можно найти и при помощи операторов «inurl» и «site» дубли, которые образовались на страницах сортировки, поиска или фильтров(sort, search,filter). Пример:

site:examplesite.net inurl:sort.

Вместо последнего атрибута можно подставлять другие: search или filter.

Отметим, что поисковые операторы демонстрируют лишь те дубли страниц на сайте, которые прошли индексацию. То есть на 100 % доверять методу не стоит, для перестраховки лучше использовать и другие подходы.

Как избавиться от дублирования контента?

Выше мы рассказали, что такое дубли и какими они бывают. Также разъяснили влияние такого явления на продвижение сайта. Теперь рассмотрим, как удалить дубли на страницах. Есть несколько способов, которые помогут решить проблему.

Настроить 301-й редирект

Это основной метод, который поможет удалить дублированный контент. Суть его заключается в автопереадресации с одной веб-страницы на другую. Боты реагируют на настройки редиректа, фиксируют, что по конкретному урлу странички больше нет.

Данный метод позволяет также передавать на главную ссылочный вес с дублей.

Использовать 301-й редирект можно для устранения копий страниц, которые появляются в результате:

- нарушений в иерархии адресов;

- использования URL в нескольких регионах;

- определения зеркала ресурса;

- проблем с множественными слешами.

К примеру, применяется метод для перенаправления с веб-страниц по типу https://site.net/catalog///product на правильную – https://site.net/catalog/product.

Настройка файла robots.txt

Этот метод помогает показывать поисковым ботам, какие из страниц или файлов не нужно сканировать.

Необходимо для этого применить «Disallow». Эта директива запрещает ботам посещать ненужные странички: Disallow: /stranica.

Стоит отметить один нюанс. Если страница в robots.txt не указана с данной директивой, то она все равно будет демонстрироваться в выдаче. Причина в том, что она ранее прошла индексацию или на нее имеются ссылки (внешние или внутренние). Согласно инструкциям, robots.txt для ботов носят поисковый характер. То есть гарантированно удалить дубли на страницах они не могут.

Метатеги noindex

Их несколько и они могут давать разные команды.

помогает указать роботу, что индексировать документ и переходить по ссылкам не нужно. Метатег в отличие от robots.txt – это прямая команда. Ее боты игнорировать не будут.

действует иначе. Он дает команду не проводить индексацию документа, но робот может переходить по тем ссылкам, которые содержатся в нем.

По заявлению представителя Google, постоянно использовать метатег «noidex, follow» и надеяться на его корректность при поиске страниц, где есть дублирование контента, не стоит. Со временем система начинает его воспринимать как «noidex, nofollow».

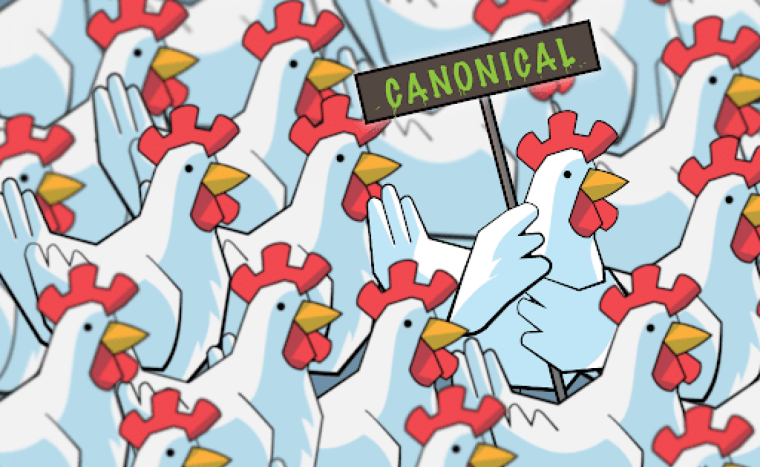

Атрибут rel="canonical"

Бывает, что нужно найти дублированный контент на сайте, но при этом удалять веб-страницу нельзя и требуется оставить ее открытой для просмотра. В таких ситуациях поможет тег на страничках с фильтрами и сортировками, utm-метками и get-параметрами. Его применяют для печати, если предвидится использование похожего содержания, но в различных языковых версиях или доменах.

Чтобы использовать атрибут rel="canonical", нужно указать адрес веб-страницы, которую нужно проиндексировать. К примеру: есть на сайте раздел «Ноутбуки». В этой категории фильтры настроены на показ разных параметров: бренд, разрешение экрана, цвет, материал корпуса и пр. Если такие страницы продвигаться не будут, то требуется в качестве канонической указать общую веб-страницу раздела. Создать ее можно через написание в HTML-коде атрибута rel="canonical". Его помещают внутри….

Пример: для страниц https://site.net/example/print, https://site.net/index.php?example=10&product=25 и прочих из раздела канонической будет выступать https://site.net/exampl. При введении в код HTML атрибута он будет выглядеть следующим образом: <link rel="canonical" href="https://site.net/example" />.</

Выводы

Рассмотрев способы, как найти дубли страниц на сайте, подведем итоги того, что мы выяснили в статье:

- Дубли. Под этим термином подразумеваются отдельные веб-страницы, содержание которых совпадает частично или полностью.

- Причины появления дублей могут быть самые разные. На их появление влияют и автогенерация, и ошибки вебмастеров, и изменения в структуре сайта.

- Дублирование контента негативно сказывается на индексации, изменении релевантной страницы в выдаче. Кроме того, такое явление приводит к потере естественных внешних ссылок на продвигаемых страницах.

- Основными методами поиска дублей являются применение специальных программ и поисковых операторов.

- В качестве инструментов для устранения дублей используются команды в robots.txt; 301 редирект, теги rel="canonical" и noindex.

Напоследок отметим, что выявлением и удалением дублей работа не завершается. Нужно обязательно проверить сайт повторно. Таким образом, получится отследить эффективность выполненных действий и выбранного метода. Проводить анализ на наличие дублей рекомендуем регулярно, только при таком условии получится вовремя заметить ошибки и удалить их, не допустив критического влияния на процесс раскрутки.