Защита IT-инфраструктуры от преступников и хакеров всегда была непростой задачей: новые угрозы в киберпространстве возникают чуть ли не еженедельно. Но стремительное развитие технологий ИИ выводит проблему на совершенно иной уровень: в недобрых руках искусственный интеллект может нанести критический ущерб любой организации.

В этом материале мы расскажем, как преступники применяют ИИ для проведения более коварных, систематических и эффективных кибератак. Вы узнаете о новых методах в арсенале хакеров, а также о способах защиты от них. Временами такие знания буквально помогают спасти бизнес от катастрофы.

Рост роли ИИ в кибератаках: насколько он опасен?

Расцвет технологий ИИ принес не только новые возможности и большие надежды, но и риски. Эксперты предупреждают о потенциальных проблемах распространения искусственного интеллекта. Так, недавний отчет Национального центра кибербезопасности Великобритании (NCSC) отмечает, что в ближайшие два года технологии ИИ почти наверняка увеличат динамику кибератак и усилят их влияние. По оценкам Центра, ИИ открывает в этом плане широкие возможности даже для преступников, не имеющих соответствующих технических навыков. Другими словами, хакерство еще никогда не было таким доступным.

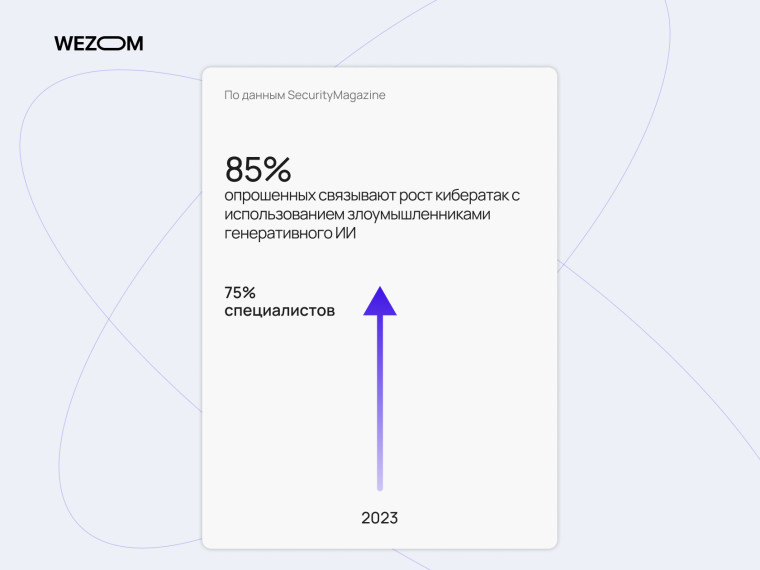

Это беспокойство разделяют и в бизнесе. Опрос SecurityMagazine 2023 года показал, что 75% специалистов по безопасности отметили увеличение количества кибератак за минувшие 12 месяцев. 85% опрошенных связывают этот рост с использованием злоумышленниками генеративного ИИ.

Как показал свежий опрос Gigamon, 82% руководителей служб безопасности и IT-отделов считают, что глобальная угроза ransomware-атак будет расти, поскольку ИИ все чаще используется в кибератаках.

Однако искусственный интеллект может применяться для самых разных преступлений: от автоматизированных DDoS-атак до сложного фишинга и социальной инженерии. К примеру:

-

В 2021 году исследователи McAfee разоблачили кампанию кибершпионажа под названием Operation Diànxùn. Преступники использовали ИИ для создания фишинговых электронных писем, нацеленных на телекоммуникационные компании по всему миру. Хакеры применили генерацию естественной речи, чтобы создавать убедительные сообщения, похожие на типичные письма рекрутеров или отраслевых экспертов. Однако эти письма содержали вложения и ссылки с вредоносным ПО.

-

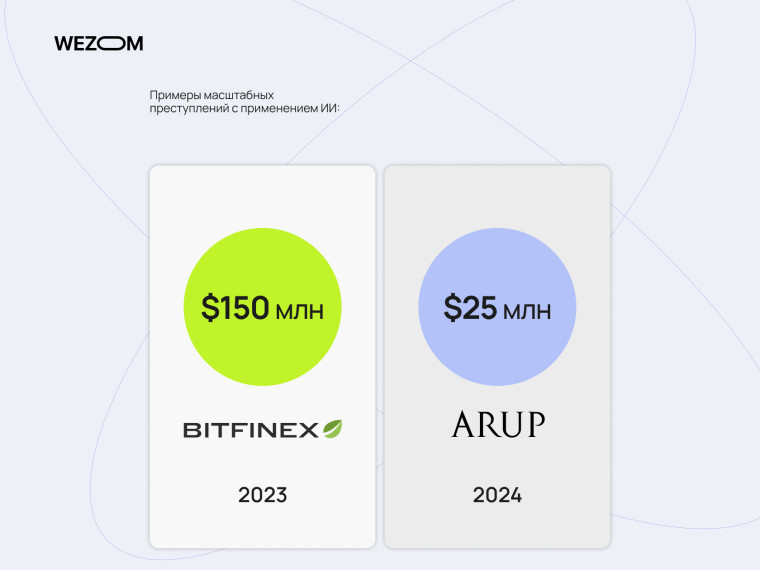

В 2023 году хакеры применили ИИ, чтобы обойти систему биометрической проверки подлинности криптобиржи Bitfinex, которая требовала от пользователей подтверждать свою личность с помощью лица и голоса. Преступники применили deepfake, чтобы генерировать реалистические изображения лиц, а также голос и поведение жертв. В результате взломщики присвоили цифровые активы на $150 млн.

-

В феврале 2024 года финансовый специалист международной инженерной компании Arup был введен в заблуждение преступниками и перевел им более $25 млн. Чтобы преодолеть сомнения менеджера по поводу странной транзакции, мошенники в режиме реального времени сгенерировали с помощью технологий Deepfake видеозвонок с финансовым директором и некоторыми другими сотрудниками.

Следовательно, даже опытным сотрудникам и продвинутым системам аутентификации трудно противодействовать новым угрозам. Более того, современные кибератаки с ИИ представляют для профессионалов огромную проблему, ведь могут менять свои параметры в реальном времени, приспосабливаясь под любые меры противодействия.

Ключевые стратегии использования ИИ в современных кибератаках

Выше мы уже описали некоторые реальные кибератаки на основе ИИ. Однако это далеко не все возможные угрозы. Стратегии применения искусственного интеллекта с преступными намерениями могут быть самыми разнообразными. Определим основные векторы таких угроз.

Адаптивные фишинговые атаки

Преступники используют средства ИИ для подготовки очень персонализированных, очень убедительных фишинговых сообщений. Такие атаки полагаются на алгоритмы искусственного интеллекта для анализа огромных объемов данных из социальных сетей, корпоративных веб-сайтов и других публичных источников, чтобы имитировать легитимные стили общения и контент, или даже повторять манеру переписки реальных сотрудников компании.

Более того, адаптивный фишинг использует элементы социальной инженерии, чтобы получить необходимую ценную информацию о жертве. В отличие от традиционных фишинговых атак, часто полагающихся на общие шаблоны, атаки с использованием GenAI могут генерировать контекстно-зависимые сообщения, нацеленные на отдельных людей. Такой уровень персонализации мешает получателям различать подлинные сообщения от мошеннических, поэтому преступники получают гораздо больше шансов на успех.

Генеративный ИИ также позволяет киберпреступникам обходить традиционные меры безопасности, нацеленные на проверку признаков традиционного фишинга. Как итог, команды безопасности сталкиваются с дополнительными сложностями в выявлении и предотвращении подобных атак с помощью стандартных инструментов.

Deepfakes

Еще недавно казалось, что биометрика и авторизация доступа по видеосвязи – это самые надежные инструменты киберзащиты. Однако все изменилось с развитием машинного и глубокого обучения. Модели ИИ могут сгенерировать практически любой медиаконтент: изображения, видео, аудио и т.д. Deepfake реального человека может быть на 100% убедительным, имитируя не только облик, но и мимику, голос и манеру общения жертвы.

На сегодня инциденты с Deepfake – это, вероятно, самые громкие киберпреступления с применением ИИ. Мошенники широко используют технологию для финансового мошенничества, дезинформации и манипуляций, которые могут нанести огромный ущерб любой организации. По подсчетам экспертов, производство одного дипфейка стоит всего полтора доллара, но уже в 2024 году глобальный ущерб от подобной практики может превысить отметку в триллион долларов.

Как показывает практика, мошенники готовят подобные атаки месяцами, прибегая к методам социальной инженерии. Жертвами фейковых видеовызовов могут стать не только рядовые сотрудники, но и топ-менеджеры с доступом к чувствительной информации и многомиллионным активам.

Автоматизация вредоносного ПО

Не секрет, что киберпреступники научились использовать генеративный ИИ, чтобы создавать вредоносный код в автоматическом режиме: максимально быстро и дешево. Несмотря на то, что технологические гиганты пытаются предотвратить использование своих языковых моделей для написания Malware, хакеры постоянно придумывают новые способы обойти ограничения. Есть целые платформы (HackedGPT, WormGPT), которые помогают преступникам создавать вредоносное ПО. Это делает динамику кибератак очень сложной, плотной и непредсказуемой.

Но в перспективе автоматизированные киберугрозы на базе ИИ могут быть гораздо более серьезными. Так, эксперты кибербезопасности Hyas создали "лабораторный" вирус BlackMamba, который может динамически менять свой код с помощью ChatGPT. В эксперименте специалистов этот червь-кейлоггер успешно адаптировался под любые сценарии и избегал обнаружения популярным антивирусным ПО. Трудно представить, насколько подобные вирусы могут осложнить работу специалистов по киберзащите, и к каким убыткам может привести их распространение в частных и государственных организациях.

Обход систем безопасности

Средства ИИ открывают для хакеров огромные возможности обхода традиционных систем киберзащиты и проведения по-настоящему комплексных атак.

Злоумышленники могут использовать алгоритмы машинного обучения для автоматического сканирования больших массивов кода и систем на наличие уязвимостей. Они получают возможность “на лету” генерировать новые эксплойты и ломать систему, даже если обнаруженная в ней уязвимость временная и кажется малозначимой. Они также получают широкие возможности для взлома паролей: как посредством брутфорса, так и с более утонченными подходами, основанными на статистике и персональных данных пользователей.

В конце концов, они могут сочетать технологические методы с фишингом и социальным инжинирингом, распространяя злокачественный софт, применяя генерацию природного языка и дипфейки.

Уязвимость организаций к подобным атакам только растет. Даже если команда по кибербезопасности использует определенные инструменты ИИ для обнаружения угроз, методы Adversarial machine learning все чаще позволяют хакерам вмешиваться в их работу и обходить защиту.

Атаки на алгоритмы машинного обучения

Сегодня бизнесы и организации массово внедряют различные средства ИИ в свои ежедневные операции, чтобы быть более эффективными. Злоумышленники получили новое поле для активности: они все чаще вмешиваются в работу алгоритмов, чтобы нарушить операции или получить неправомерный доступ к ресурсам системы. Эта практика получила название "сопернического машинного обучения" (adversarial machine learning). Ее суть состоит в том, чтобы ввести в заблуждение модель ИИ, используя специальные наборы данных или прочие инструменты.

К методам сопернических атак обычно относят такие методы как атаки уклонения (evasion), отравления (poisoning) и извлечения модели.

-

Атака отравления осуществляется на этапе обучения или дообучения модели ИИ. Внесение "отравленных" данных на этой фазе приводит к тому, что модель будет генерировать ложные результаты.

-

Атака уклонения – самый распространенный метод. Его суть состоит в том, что взломщик манипулирует данными на этапе развертывания модели, чтобы вывести ее из строя. Типичным примером evasion-атак являются атаки подмены, от которых все чаще страдают системы биометрической верификации.

-

Атака извлечения строится на возможности взломщика реконструировать модель ИИ через экстракцию данных, на которых она натренирована. Так злоумышленники могут не просто скопировать ваш продукт, но и обнаружить в нем уязвимости для более коварных кибератак.

Вредоносное ПО для преодоления защиты

С появлением ИИ разработчики вредоносного софта получили возможность использовать алгоритмы для автоматизации и усовершенствования своих атак на всех уровнях: от предварительной разведки до уклонения от детекции. Кибератаки на базе ИИ стали более коварными и целеустремленными – они могут легко обходить традиционные системы безопасности.

В мире киберугроз привычные нам вирусы и файерволы стремительно теряют эффективность. Традиционным средствам защиты трудно выявить вредоносный код на базе ИИ из-за его динамической и полиморфной природы. К примеру, “червь” на базе ИИ может "мутировать" в режиме реального времени, скрывая свое присутствие в системе неделями и месяцами. При этом даже несколько часов работы такого софта в корпоративной сети могут привести к масштабной компрометации данных с непредсказуемыми последствиями.

Команды безопасности сталкиваются с большими проблемами при обнаружении и изоляции этих угроз, особенно в режиме реального времени.

Автоматизированные DDoS-атаки

За последние годы автоматизация и скриптинг сделали атаки отказа в обслуживании (DDoS) достаточно простыми в реализации. Порог входа низок как никогда: даже пользователь без особых технических навыков может включиться в процес DDoS и при определенных обстоятельствах нанести целевой системе существенный вред.

Однако внедрение инструментов ИИ – это совершенно другой уровень автоматизации. Теперь злоумышленники могут опираться на обработку огромных объемов данных телеметрии безопасности. Этот непрерывный анализ позволяет оптимизировать технику атаки в реальном времени, гибко распределяя ресурсы для достижения разрушительного эффекта. Технологии ИИ позволяют с исключительной эффективностью маскировать DDoS-атаки под обычный трафик, что делает противодействие им крайне сложной задачей.

Автоматизированные DDoS-атаки на базе ИИ отличаются от традиционных простотой масштабирования, гибкостью и качеством маскировки. Низкий порог входа и высокая эффективность ИИ могут привести к значительному росту количества DDoS-атак: они будут создавать нагрузку на сети и специалистов, даже если они будут относительно простыми.

Устойчивые угрозы высокой сложности

Если рассматривать киберугрозы ИИ в более широком контексте, то искусственный интеллект создает совершенно новый ландшафт рисков для IT-инфраструктуры. Теперь хакеры опираются на возможности сбора и обработки огромных объемов данных в реальном времени, чтобы находить уязвимости в системах и планировать атаки с хирургическим усердием. Они могут практически непрерывно генерировать вредоносный код и создавать сетевых червей, которые постоянно мутируют избегая обнаружения месяцами. Это настоящее кибероружие, способное похищать данные, нарушать работу систем и буквально сеять хаос.

Эти хронические угрозы наивысшего уровня на сегодня не имеют простого решения. Организациям, IT-подразделениям и командам безопасности придется смириться с этими реалиями, чтобы строить свои стратегии защиты соответственно. Современная архитектура кибербезопасности должна базироваться на гибкости, проактивном подходе, внедрении передовых технологий, а также на сотрудничестве с частными IT-командами и государственными институтами.

Как защититься от кибератак с использованием искусственного интеллекта: основные стратегии

Новые киберугрозы на основе ИИ не похожи на вызовы, с которыми специалисты безопасности сталкивались ранее. Реагирование на новые риски требует поиска новых подходов и технологий. Определим основные принципы, на которых должна строиться современная стратегия безопасности.

- Усиленное обучение персонала

Сотрудники организации должны быть осведомлены о новых угрозах, таких как персонализированные фишинговые письма высокого качества, ИИ-боты и дипфейки, способные убедительно имитировать человеческое поведение в сети. Следует научить специалистов распознавать подобные инструменты и адекватно реагировать на них. Важно сформировать в команде культуру кибербезопасности: персонал должен осознавать свою роль в защите и сообщать специалистам о любых аномалиях в системе.

- Использование интегрированных систем защиты

Современные интегрированные системы киберзащиты объединяют ряд инструментов и технологий безопасности в единую логику. Они призваны защищать компанию на нескольких уровнях: как от опасностей за пределами периметра, так и от рисков внутреннего характера. В состав интегрированных систем входят инструменты на базе ИИ, позволяющие эффективно распознавать вторжения, выявлять уязвимости, управлять доступом к ресурсам и объединять данные из разных точек безопасности в режиме реального времени.

- Применение многоуровневых механизмов защиты

Многомерный подход к кибербезопасности основывается на идее, что ни один механизм защиты не является безотказным. Следовательно, стратегия противодействия угрозам должна быть глубокой и опираться на несколько уровней контроля угроз, каждый из которых усложняет задачу для злоумышленников. В целом многоуровневая стратегия работает на трех уровнях: сетевая безопасность, безопасность конечных точек доступа к системе, а также безопасность учетных записей. Сочетая эти уровни, организации могут создать сильную и надежную систему защиты, которая сможет вовремя реагировать на любые угрозы.

- Анализ и мониторинг трафика

Без качественного мониторинга трафика в реальном времени невозможно обеспечить системе безопасный периметр, особенно когда речь идет об изменчивых и обманчивых угрозах на базе ИИ. Сегодня анализ логов, пакетная инспекция и другие методы мониторинга должны опираться на собственные алгоритмы машинного обучения, чтобы выявлять подозрительную активность и попытки проникновения в систему еще на ранних этапах. Только инструменты ИИ могут обеспечить мониторингу соответствующий уровень скорости и точности.

- Обновление и патчи систем

Злоумышленники научились использовать ИИ для генерации огромных объемов вредоносного кода и поиска уязвимостей в системах на основе анализа данных. Так что команды киберзащиты не могут критически отставать от этих темпов. Непрерывный мониторинг угроз и pen-тестирование должны быть основой для регулярных и своевременных патчей безопасности системы. Даже если они не смогут устранить все уязвимости, то усложнят злоумышленникам задачу взлома и выиграют команде защитников время на реагирование.

- Реагирование на инциденты

Организации должны иметь четкий план реагирования на кибератаки с использованием искусственного интеллекта. Важно иметь под рукой эффективные системы выявления аномалий и принимать меры по противодействию угрозе мгновенно, изолируя поврежденные системы и приостанавливая подозрительные процессы. Наличие резервных копий данных и запасных каналов коммуникации крайне важно для поддержания работы организации во время атаки. После того как инцидент был исчерпан, важно провести его тщательный анализ и сделать выводы на будущее.

Стандарты и рекомендации по минимизации рисков кибератак с ИИ

Ведущие специалисты по кибербезопасности и государственные регуляторы прекрасно понимают угрозу, которую несут атаки на базе ИИ на ПО. Поэтому они сформировали целый ряд отраслевых рекомендаций и стандартов киберзащиты. Их соблюдение является самым лучшим решением с точки зрения комплаенса и безопасности IT-инфраструктуры.

Международные стандарты ISO

Международная организация стандартизации (ISO) и Международная электротехническая комиссия (IEC) сформировали собственные стандарты в сфере информационных технологий. Назовем их

- ISO/IEC 2382:2015

Фактически это технический словарь, созданный специалистами области для упрощения международного сотрудничества и взаимодействий в сфере информационных технологий. Целью ISO/IEC 2382 было формирование определений, которые могут быть недвусмысленными, доступными и понятными всем заинтересованным сторонам. Версия 2015 года получила ряд ключевых технических определений по информационной и кибербезопасности, а также защите персональных данных. На сегодня стандарт находится на стадии просмотра и должен получить обновления в обозримом будущем.

- ISO/IEC 27001

Это самый известный стандарт реализации систем управления информационной безопасностью, последний раз его обновили в 2022 году. Он предоставляет организациям любого направления и масштабов руководство по созданию, внедрению, поддержке и постоянному совершенствованию системы киберзащиты. ISO/IEC 27001 продвигает комплексный подход к информационной безопасности, охватывающий проверку отдельных людей, цифровых объектов, информационных политик и технологий. Соответствие организации требованиям ISO/IEC 27001 гарантирует, что она внедрила общепризнанные отраслевые практики и принципы защиты данных.

- ISO/IEC 27005

Этот стандарт содержит подборку методических установок по обеспечению безопасности данных и управлению рисками, которые помогают организациям выполнять требования ISO/IEC 27001. Стандарт 27005 определяет ключевые принципы, которые помогают руководителям и персоналу организации определять контекст ситуации, оценивать риски, вести мониторинг, а также определять степень допустимых рисков в организации работы с данными. Применение ISO/IEC 27005 улучшает качество принятия решений безопасности и продвигает системный подход к киберзащите.

- ISO/IEC 26514

Данный стандарт определяет основные принципы проектирования и разработки пользовательской информации в продуктах системной и программной инженерии. Он направляет работу дизайнеров интерфейсов, специалистов по юзабилити и разработчиков контента, помогая определить, какая информация необходима пользователям, как ее обработать, как представить данные доступно и безопасно. Нормы ISO/IEC 26514 охватывают весь жизненный цикл продукта: от определения концепции и разработки до поддержки после релиза.

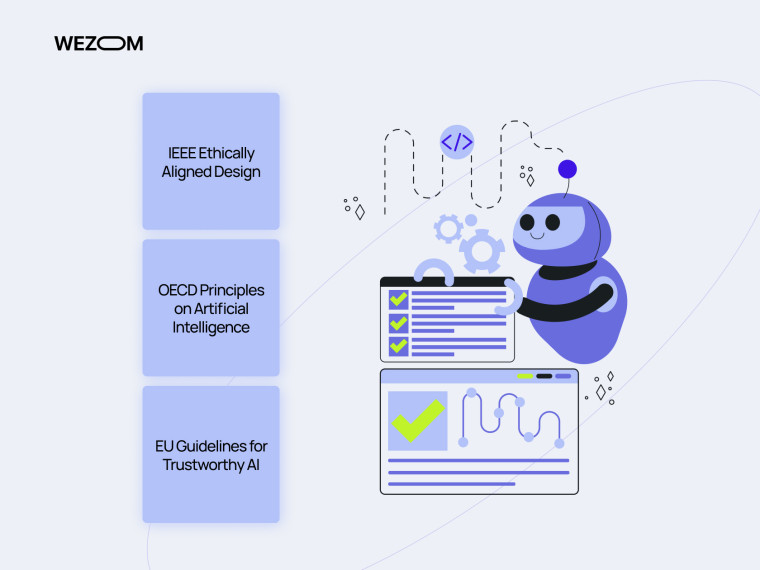

Рекомендации по этике и ответственности

Мировое сообщество движется к определению границ нравственности применения ИИ в тех или иных задачах. Следование рекомендациям международных организаций и отраслевых объединений является важным условием для формирования безопасного киберпространства.

- IEEE Ethically Aligned Design

Американский Институт инженеров по электротехнике и электронике (IEEE) является одним из крупнейших в мире профессиональных технических объединений. Его участники ставят целью гуманистическое и нравственное развитие новейших технологий. Инициатива Ethically Aligned Design направлена на то, чтобы сделать автономные и интеллектуальные системы безопасными. Она содержит научный анализ и ресурсы, фундаментальные основы и практические рекомендации по созданию и поддержке безопасных интеллектуальных систем. Более того, гайдлайн IEEE предлагает конкретные указания по стандартам, сертификации и регулированию работы продуктов на базе ИИ.

- OECD Principles on Artificial Intelligence

Организация экономического сотрудничества и развития (OECD) объединяет 38 развитых стран, признающих принципы либерализма и рыночной экономики. В связи со стремительным развитием технологий ИИ эксперты OECD сформулировали базовые принципы применения искусственного интеллекта. В частности, продукты на базе ИИ должны разрабатываться и развертываться с соблюдением принципов верховенства права и прав человека (например, в части защиты персональных данных). Организации и лица, разрабатывающие, развертывающие или эксплуатирующие системы ИИ, должны нести полную ответственность за их надлежащую и безопасную работу.

- EU Guidelines for Trustworthy AI

Еврокомиссия также разработала собственный гайд по безопасному внедрению ИИ. Согласно рекомендациям ЕК, продукт на базе искусственного интеллекта должен в течение всего своего жизненного цикла отвечать требованиям законности (не противоречить действующему законодательству), быть этичным (не противоречить гуманистическим ценностям), а также быть технически и социально надежным, чтобы его нельзя было применить во вред человеку. В идеале эти три компонента в симбиозе должны обеспечивать безопасность. Кроме того, в странах ЕС действуют жесткие требования по защите персональных данных, предусмотренные регламентом GDPR и национальными законами стран ЕС.

Безусловно, никакие стандарты, руководства и декларации сами по себе не могут обеспечить безопасность в киберпространстве. Однако они дают организациям и специалистам правильный вектор развития, чтобы противостоять новейшим угрозам.

Создавайте безопасные решения с WEZOM

Команда WEZOM уже более 25 лет создает индивидуальные IT-продукты для корпоративного сектора. Наши клиенты – ведущие украинские и мировые компании, работающие в сферах eCommerce, производства, логистики, ритейла, энергетики и т.д. Это означает, что наши специалисты имеют уникальный и неоценимый опыт построения диджитал-решений с особыми требованиями к безопасности данных и защите операций.

Наши специалисты четко понимают, как реализовать безопасную и устойчивую архитектуру IT-продукта, как поддерживать такие решения, обнаруживать уязвимости в системах и строить комплексные стратегии киберзащиты. В одном из наших недавних кейсов мы провели комплексное pen-тестирование веб-приложения клиента и устранили ряд слабых мест, которыми могли легко воспользоваться киберпреступники. С другой стороны, команда WEZOM имеет опыт разработки и развертывания продуктов на базе ИИ, поэтому хорошо понимает их логику работы и современные возможности, а значит и потенциальные сопутствующие риски.

Если вы ищете команду с подобным опытом, чтобы реализовать безопасное IT-решение, то оказались на правильной странице. Обращайтесь за консультацией к нашим специалистам прямо сейчас. Они с удовольствием изучат вашу проблему, поделятся собственным опытом и подскажут оптимальные решения для киберзащиты.

Выводы

Искусственный интеллект похож на атомную энергетику. Эта технология принесла невероятные возможности, но в то же время создала огромные риски. В руках преступников новые технологии превращаются в оружие: атаки на безопасность с ИИ могут нанести катастрофический ущерб любой диджитал-инфраструктуре.

Следовательно, организациям и командам по кибербезопасности стоит отнестись к новым рискам крайне серьезно. Освоение новейших технологий защиты на базе ИИ, углубленное обучение персонала, перестройка стратегий безопасности в соответствии с новейшими стандартами и рекомендациями специалистов – все эти шаги прямо сейчас должны стать приоритетными для большинства бизнесов. Однако далеко не каждая организация обладает соответствующими ресурсами и опытом, чтобы защитить себя своими силами. Лучшим решением в таком случае будет обращение к опытной IT-команде, имеющей за плечами релевантное портфолио.